정규화 기술로 머신러닝과 딥러닝 모델 간소화하기

정규화(Regularization)는 머신러닝과 딥러닝 모델에서 매우 중요한 개념입니다. 복잡한 모델이 종종 데이터에 지나치게 적합되어 과적합(Overfitting)이 발생하는 문제는, 정규화를 통해 해결할 수 있습니다. 이 과정은 모델의 복잡도를 줄이고, 새로운 데이터에 대해 더 일반화된 예측 능력을 갖게 만듭니다.

과적합이란 무엇인가?

과적합은 모델이 학습 데이터에 포함된 군더더기까지 학습해버리는 현상입니다. 이는 마치 학생이 정답을 이해하지 못하고, 답을 암기만 한 상태와 비슷합니다. 시험에서는 다른 문제들이 나오기 때문에, 그 학생은 제대로 답변하기 어려워질 것입니다. 마찬가지로, 과적합된 모델은 새로운 데이터에 대해 정확한 예측을 하지 못할 수 있습니다.

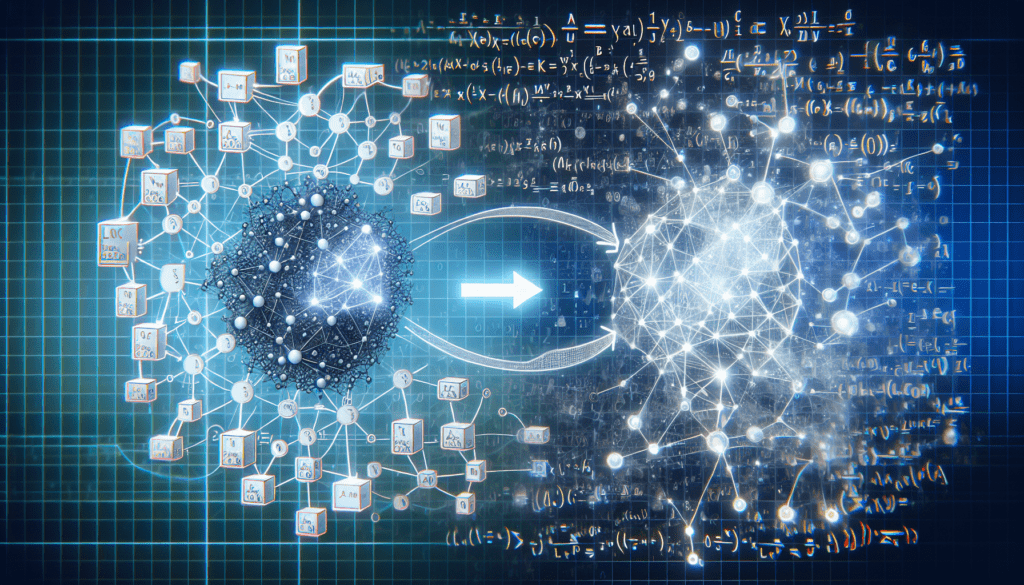

정규화의 이해

정규화는 모델이 너무 많은 세부적인 정보를 학습하는 것을 방지하기 위한 기술입니다. 이는 모델에 제약을 주어 본질적인 패턴에 집중하게끔 합니다. 예를 들어, 모델이 단순한 구조를 유지하면서 복잡한 형태의 데이터를 처리할 수 있도록 도와줍니다. 대표적인 방법으로 L2 정규화와 L1 정규화,.dropout 정규화 등이 있습니다.

대표적인 정규화 기술들

1. L2 정규화 (Ridge 정규화)

L2 정규화는 손실 함수에 페널티 항을 추가함으로써, 중요도가 적은 특징의 가중치를 0에 더 가깝게 하는 방식입니다. 이는 모델이 데이터의 미세한 변동에 덜 민감하게 만듭니다.

- 예제: 가중치가 [0.5, 1.2, -0.9]인 경우, L2 정규화를 적용하면 이 값들이 0에 더 가까워져서 모델을 단순하게 만들어 줍니다.

2. L1 정규화 (Lasso 정규화)

L1 정규화는 가중치의 절대값의 합에 페널티를 부과합니다. 이는 많은 가중치를 정확히 0으로 만들며, 중요하지 않은 특징을 모델에서 제거하는 데 유용합니다.

- 예제: 가중치가 [0.5, 1.2, -0.9]인 경우, L1 정규화는 중요도가 낮은 가중치는 0으로 설정할 수 있습니다.

3. 드롭아웃 정규화

드롭아웃은 신경망에서 훈련 중 무작위로 뉴런을 꺼두는 방법입니다. 이는 모델이 특정 뉴런에 지나치게 의존하지 않도록 하며, 모델의 일반화 능력을 향상시킵니다.

- 예제: 100개의 뉴런이 있는 레이어에서 20% 드롭아웃을 적용하면, 훈련의 각 단계마다 무작위로 20개의 뉴런을 비활성화시킵니다.

정규화를 사용하는 이유

정규화는 모델이 훈련 데이터와 테스트 데이터 모두에서 높은 성능을 유지하도록 도와줍니다. 이러한 기법이 없다면, 모델은 훈련 데이터에서는 잘 작동하더라도 새로운 데이터에서는 부정확한 결과를 낼 가능성이 높습니다. 정규화는 모델의 복잡성과 정확성 사이에 적절한 균형을 맞춥니다.

정규화 적용 방법

정규화를 머신러닝 라이브러리에서 적용하는 것은 비교적 간단합니다. 파이썬에서 텐서플로(TensorFlow)를 사용하여 이를 구현해보면 다음과 같습니다:

import tensorflow as tf

from tensorflow.keras import layers, regularizers

# L2 정규화를 적용한 간단한 모델 정의

model = tf.keras.Sequential([

layers.Dense(128, activation='relu', kernel_regularizer=regularizers.l2(0.01)),

layers.Dropout(0.2),

layers.Dense(64, activation='relu', kernel_regularizer=regularizers.l2(0.01)),

layers.Dense(1, activation='sigmoid')

])

# 모델 컴파일

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

# 모델 훈련

history = model.fit(X_train, y_train, epochs=10, validation_data=(X_val, y_val))

이 코드에서는 Dense 레이어에 L2 정규화를 추가하고, 드롭아웃 레이어를 도입하여 특정 경로에 대한 의존성을 줄이고 있습니다.

결론

정규화는 머신러닝 및 딥러닝 모델에서 언더피팅(Underfitting)과 과적합 사이의 균형을 맞추는 데 필수적인 역할을 합니다. 정규화 매개변수를 신중하게 조정함으로써, 모델은 다양한 데이터셋에 걸쳐 견고하고 유연하며 신뢰할 수 있는 예측을 수행할 수 있습니다. L2 정규화를 통한 가중치 조정이든, 드롭아웃을 통한 뉴런 의존성 억제든, 이런 기술들은 모델이 잘 일반화할 수 있도록 도와줍니다.